Discussão sobre a autonomia de armas vai de drones a ‘robôs assassinos’

Armas autônomas letais preocupam sociedade civil e governos; Brasil vai à ONU em agosto defender sua posição contra

Robôs de guerra, desenvolvidos para matar. A ideia vem preocupando governos e a comunidade internacional. Deveria haver um futuro em que robôs, sozinhos, pudessem identificar pretensos alvos e tomar decisões irreversíveis? Os sistemas de armas autônomas letais (LAWS, na sigla em inglês), também conhecidos como robôs assassinos ou de guerra, estão sendo discutidos formalmente pela Organização das Nações Unidas (ONU) desde 2017. A próxima reunião, na Suíça, está marcada para 20 de agosto, com participação do Brasil.

O encontro reunirá o Grupo de Experts Governamentais (GEE), formado por embaixadores, ministros e militares. Representante especial do Brasil para a Conferência de Desarmamento, em Genebra, o embaixador Guilherme Patriota esteve no último encontro. Segundo ele, o posicionamento brasileiro é de que essas armas não deveriam ser admitidas. “Em tese, o Brasil apoiaria a negociação de algum tipo de acordo internacional que estabelecesse o padrão de ter um controle humano significativo em todo o sistema letal de armas, autônomo ou não”, afirma.

Em agosto, um dos representantes do Brasil na reunião do GEE será o chefe do departamento de Defesa do Ministério das Relações Exteriores, embaixador Alessandro Candeas. Ele explicou ao Estadão QR que vai reafirmar o posicionamento brasileiro contra as armas totalmente autônomas.

O embaixador Candeas também explica que um tratado pode banir as armas plenamente autônomas e regular a autonomia de outras.

Campanha

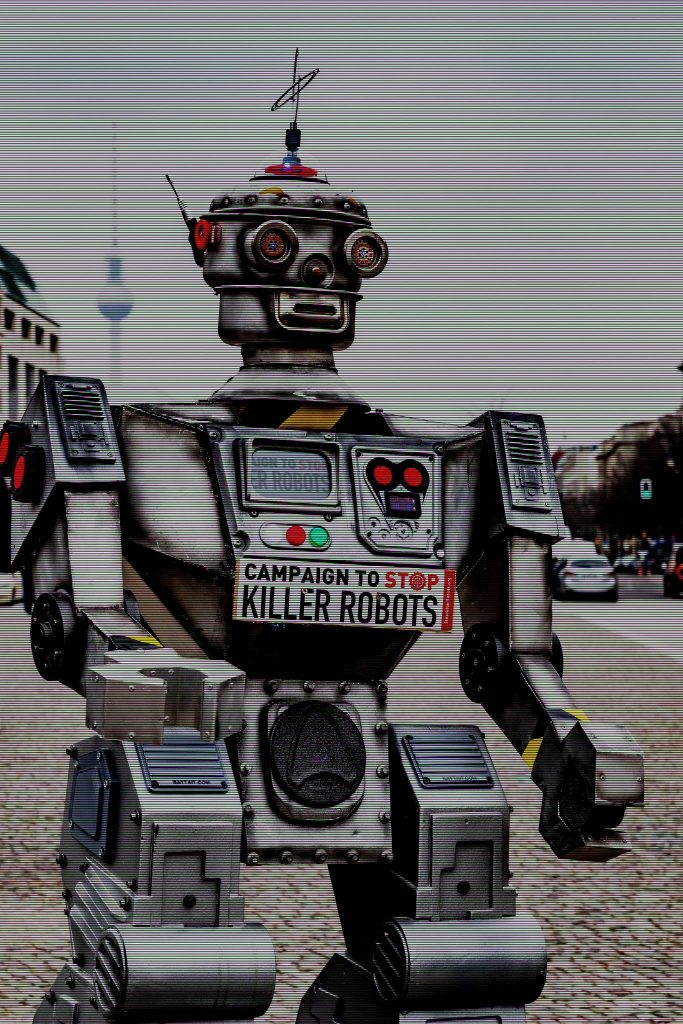

Ter um tratado internacional para banir o desenvolvimento, a produção e o uso de robôs assassinos é justamente a principal bandeira da campanha Stop Killer Robots. Criada em 2013, a iniciativa reúne 112 ONGs de 55 países.

“Robôs assassinos cruzam uma linha moral vermelha”– Mary Wareham, líder da campanha mundial Stop Killer Robots

Fotomontagem de Tomás Conte com imagem de Clare Conboy/Stop Killer Robots/Divulgação, com intervenção do Photomosh

Coordenadora da campanha, Mary Wareham diz que passou os últimos 20 anos tentando “prevenir e mitigar” o sofrimento humano causado por armas. Inicialmente, as de fogo. E agora os robôs.

“São levantadas várias questões como falta de responsabilização para crimes cometidos por armas completamente autônomas no futuro”, explica Mary. “Quem seria responsabilizado por essas ações: o programador, o fabricante, o comandante? Ainda não está claro.”

Armas robóticas

Há diferentes graus de autonomia dos robôs de guerra. Em 2012, A Human Rights Watch e a International Human Rights Clinic divulgaram um relatório com os três principais níveis de autonomia de armas robóticas:

- Human-in-the-Loop: Robôs que podem selecionar alvos e empregar força somente a partir de um comando humano

- Human-on-the-Loop: Robôs que podem selecionar alvos e empregar força sob supervisão de um operador humano que pode anular as ações dos robôs

- Human-out-of-the-Loop: Robôs capazes de selecionar alvos e empregar força sem qualquer interação ou entrada humana.

Ralf Schlesener/Stop Killer Robots/Divulgação, com intervenção do Photomosh

Drones

De modo geral, as plataformas de inteligência não tripuladas são os drones. Apesar de não serem considerados LAWS, esses equipamentos são as armas mais utilizadas hoje no meio militar, como explica o repórter especial do Estadão e especialista em assuntos militares, Roberto Godoy.

Segundo ele, o Instituto Militar de Engenharia tem vários protótipos em teste de sistemas terrestres de emprego militar totalmente automatizados.

O assunto é complexo não apenas do ponto de vista de relações internacionais, mas também quanto ao papel dos países na indústria do armamento automatizado. “Pessoalmente, acho que nunca teremos um processo absolutamente robotizado”, afirma Godoy.

Quer saber mais? Acompanhe o debate sobre as questões éticas que permeiam o campo da robótica e da inteligência artificial na thread no Twitter. Também confira o podcast do Estadão QR sobre robôs do mal.

Nenhum comentário:

Postar um comentário